Benchmarks comparam desempenho e precisão do Claude Opus 4.6 e 4.7

Testes de 'Prompt Steering' avaliam a capacidade de resposta e controle das novas iterações do modelo da Anthropic.

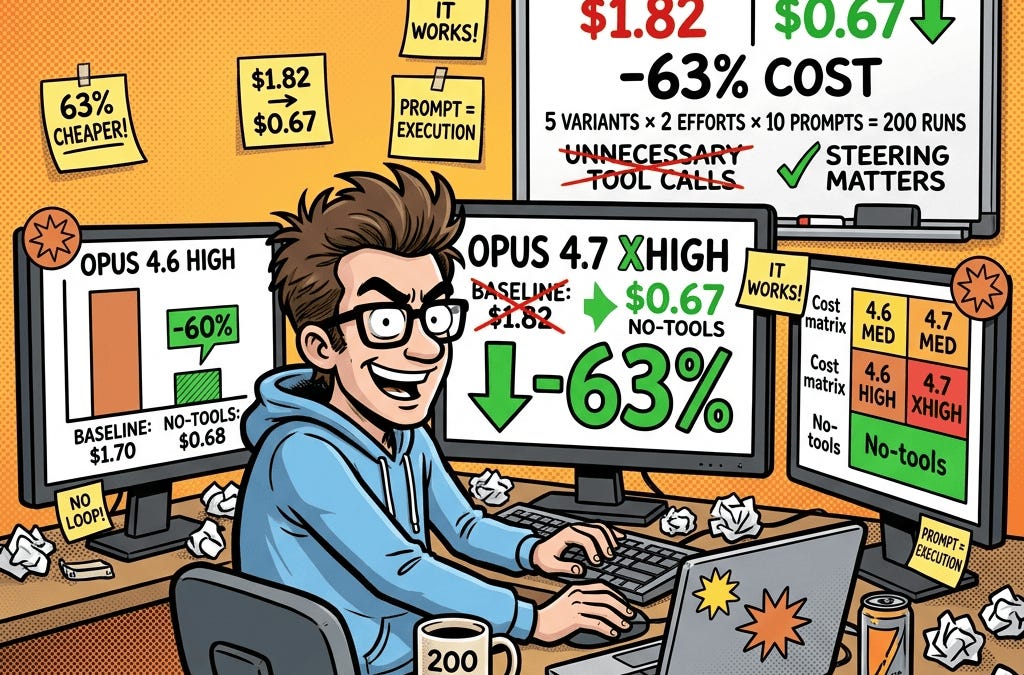

63 por cento de economia. Esse é o número impressionante que uma única frase pode gerar na sua conta de API.

Novos benchmarks revelam como o Claude Opus 4.7 reage a diferentes níveis de esforço. E o resultado é um alerta para desenvolvedores.

Será que vale a pena economizar tokens se a precisão do modelo despenca?

O que muda com o Prompt Steering

> "O prompt que você coloca antes de uma tarefa faz mais do que definir o tom; ele determina o uso de ferramentas e o volume de raciocínio."

O conceito de *Prompt Steering* (direcionamento de prompt) ganhou força com as atualizações da Anthropic. Na prática, ele permite controlar o quanto de 'energia' o modelo gasta.

Segundo o especialista George Liu, essa técnica é fundamental no ambiente Claude Code. O modelo agora calibra seu esforço de acordo com a complexidade da tarefa.

Isso significa que o modelo decide se deve ler arquivos ou fazer chamadas de ferramentas. Tudo isso impacta diretamente no custo final da inferência.

O custo real da inteligência

O benchmark conduzido por Liu foi massivo e rigoroso. Foram utilizadas 200 sessões de Claude Code para comparar as versões 4.6 e 4.7.

Para medir os dados, ele utilizou o seu próprio session-metrics skill plugin. O objetivo era entender onde os tokens estavam sendo consumidos.

Os testes focaram no Claude Opus 4.6 (nível alto) contra o Claude Opus 4.7 (nível extra-alto). A diferença de comportamento entre as iterações surpreendeu.

A economia de 63%

Ao adicionar uma frase simples antes do prompt, os custos despencaram. A instrução era clara: responder apenas com conhecimento próprio, sem invocar ferramentas.

Confira os números de custo para os mesmos 10 prompts:

- Opus 4.7 (sem restrição): US$ 1,82

- Opus 4.7 (com restrição): US$ 0,67

- Redução total: 63% de economia no bolso do desenvolvedor.

- Opus 4.6 (com restrição): US$ 0,68 (redução de 60%).

O preço da imprecisão

Nem tudo são flores no mundo da economia de tokens. O benchmark mostrou que o desempenho sofreu um golpe significativo.

No Claude Opus 4.7, a capacidade de seguir instruções caiu de 8/9 para 6/9 com o prompt restritivo. O modelo simplesmente parou de completar tarefas que exigiam leitura de arquivos.

Isso acontece porque, ao ser instruído a economizar, o modelo perde o acesso a recursos cruciais. Na prática, você paga menos por um resultado incompleto.

O paradoxo do pensamento profundo

Liu também testou o oposto: pedir para o modelo pensar mais. A frase usada foi: "Pense de forma mais profunda e completa sobre este problema".

Os resultados foram desanimadores para quem busca mais precisão:

- Aumento de custo: 22% mais caro (subindo para US$ 2,22).

- Desempenho: Manteve-se em 8/9, sem melhoria real.

- Conclusão: Mais caro, mas não necessariamente mais inteligente.

Por que isso importa agora

A Anthropic documenta esse comportamento oficialmente. O guia de prompts do Claude Opus 4.7 explica que o raciocínio estendido é moldado pelo prompt.

Para empresas que rodam milhares de chamadas de API, entender esse equilíbrio é vital. Um prompt mal estruturado pode queimar o orçamento mensal em poucas horas.

O uso de ferramentas, leituras de cache e turnos extras de agentes são cobrados. E o Claude Opus 4.7 parece ser mais sensível a essas variações do que seus antecessores.

O veredito

O cenário atual exige que desenvolvedores sejam quase "economistas de tokens". O benchmark de George Liu prova que a eficiência máxima não vem de graça.

Se você precisa de precisão absoluta em tarefas de codificação, o custo extra é inevitável. Tentar forçar economia pode quebrar a lógica do modelo.

Por outro lado, para tarefas simples, o *Prompt Steering* é uma ferramenta poderosa. Saber quando 'soltar as rédeas' da IA é o novo diferencial técnico.

Qual dessas abordagens você vai adotar no seu próximo projeto: precisão total ou economia máxima?

Redação SWEN

Equipe Editorial

A equipe SWEN é formada por especialistas em Inteligência Artificial e tecnologia, trazendo as notícias mais relevantes do setor com análises aprofundadas e linguagem acessível. Nossa missão é democratizar o conhecimento sobre IA para todos os brasileiros.